Monolog 优化及打造 ELK 友好的日志格式

Monolog 是目前最流行的php日志库,许多流行的php框架都用Monolog作为默认的日志库,例如symfony、laravel。

默认情况下,symfony、laravel在打印日志时都是来一条日志就打印一行到日志文件,这样就没有办法按照请求将日志聚合起来,更麻烦的是,多个并发的请求打印的日志是交叉的,这给本地调试、线上排查bug带来了许多麻烦。

我希望的结果是:

- 一次请求所产生的日志是紧密相连的,不会因为高并发而产生日志交叉的情况。

- 能够通过Logstash的multiline来聚合一次请求所产生的所有日志。

- 一些访问数据(如访问时间、访问者IP、访问的Url、该请求的执行时间等)能够被Logstash直接解析成字段,并能够在Kibana中查询、筛选。

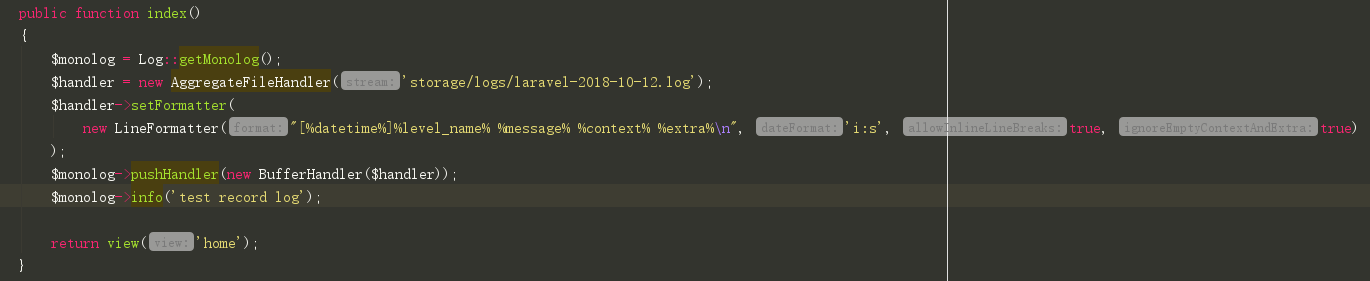

最终代码如下:

namespace App\Extensions\Log;

use Carbon\Carbon;

use Monolog\Handler\StreamHandler;

use Monolog\Logger;

class AggregateFileHandler extends StreamHandler

{

public function handleBatch(array $records)

{

$dur = number_format(microtime(true) - LARAVEL_START, 3);

$request = request();

$format = 'Y-m-d H:i:s.u';

// 这一行是我们这个处理器自己加上的日志,记录请求时间、响应时间、访客IP,请求方法、请求Url

$log = sprintf(

"[%s][%s]%s %s %s\n",

Carbon::createFromFormat('U.u', sprintf('%.6F', LARAVEL_START), config('app.timezone'))->format($format),

$dur,

$request->getClientIp(),

$request->getMethod(),

$request->getRequestUri()

);

// 然后将内存中的日志追加到$log这个变量里

foreach ($records as $record) {

if (!$this->isHandling($record)) {

continue;

}

$record = $this->processRecord($record);

$log .= $this->getFormatter()->format($record);

}

// 调用日志写入方法

$this->write(['formatted' => $log]);

}

}需要BufferHandler来配合使用:

$handler = new AggregateFileHandler($path_to_log_file);

$handler->setFormatter(

new LineFormatter("[%datetime%]%level_name% %message% %context% %extra%\n", 'i:s', true, true)

);

$monolog->pushHandler(new BufferHandler($handler));AggregateRotatingFileHandler类只实现了一个handleBatch方法,BufferHandler会在请求结束时去调用handleBatch方法,因为我们不考虑单独使用这个处理器的情况,所以就没有去重写handler方法(实际上重写了也没法满足我们的需求)。

Logstash的配置如下:

input {

file {

type => 'monolog'

path => "/home/vagrant/website/logs/app.log"

}

}

filter {

if [type] == 'monolog' {

multiline {

pattern => "\[[\d\-\: ]+?\]\[[\d\.]+?\]\d+\.\d+\.\d+\.\d+ \S+ \S+"

negate => true

what => "previous"

}

grok {

match => ["message", "\[%{TIMESTAMP_ISO8601:time}\]\[%{NUMBER:duration}\]%{IP:ip} %{WORD:method} %{DATA:url}\n%{GREEDYDATA:data}"]

}

}

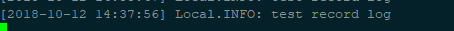

}贴一个从ElasticSearch中查出的日志

{

"_index" : "monolog",

"_type" : "monolog",

"_id" : "AVkgdHh4eDK8-gwc8OTf",

"_score" : 1.0,

"_source" : {

"message" : "[2016-12-21 08:16:27.373000][2.421]127.0.0.1 GET / \n[16:29]INFO Test Log 1\n[16:29]INFO Test Log 2",

"@version" : "1",

"@timestamp" : "2016-12-21T08:16:55.485Z",

"path" : "/home/vagrant/online/website/logs/monolog.log",

"host" : "0.0.0.0",

"type" : "monolog",

"tags" : [ "multiline" ],

"time" : "2016-12-21 08:16:27.373000",

"duration" : "2.421",

"ip" : "127.0.0.1",

"method" : "GET",

"url" : "/",

"data" : "[16:29]INFO Test Log 1\n[16:29]INFO Test Log 2"

}

}本作品采用《CC 协议》,转载必须注明作者和本文链接

关于 LearnKu

关于 LearnKu

推荐文章: